NVIDIA GB200 架构深度解析:机柜级 AI 超级计算机

NVIDIA GB200 架构深度解析:机柜级 AI 超级计算机

摘要:NVIDIA GB200 不是简单的硬件升级,而是 AI 推理时代的基础设施。本文深入解析 GB200 NVL72 的架构创新,包括 Dual-Die 设计、对称内存、FP4 精度和 130 TB/s 铜缆背板等核心技术。

🎯 引言:为什么 GB200 是历史性的?

现代数据中心正在从离散服务器集群演变为统一的计算网络(即 AI Factory),而 NVIDIA Blackwell GB200 架构正是这一演变的巅峰之作。

与 H100 相比,GB200 带来的不是线性提升,而是代际飞跃:

| 指标 | GB200 NVL72 | H100 集群 | 提升 |

|---|---|---|---|

| 推理吞吐 (万亿参数模型) | 30x | 1x | 30 倍 |

| 能耗 (同等性能) | 1/25 | 1x | 25 倍降低 |

| TCO (总拥有成本) | 1/25 | 1x | 25 倍降低 |

核心洞察:GB200 重新定义了”GPU”——它不再是一个独立的芯片,而是一个72 处理器机柜级计算机的组成部分。

📐 一、核心架构:从芯片到机柜

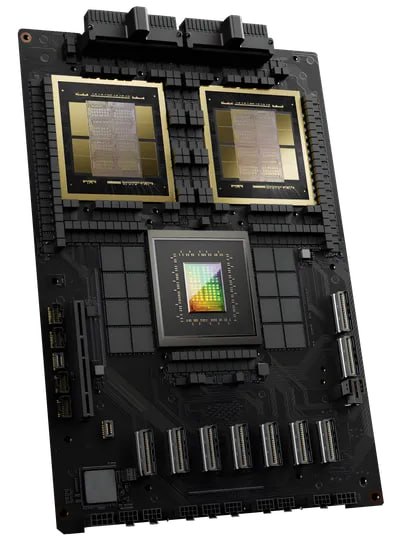

1.1 Dual-Die 设计:突破物理极限

由于单枚晶圆接近 Reticle Limit(光刻极限),Blackwell 采用了激进的双芯片设计:

1 | ┌─────────────────┐ ┌─────────────────┐ |

关键数据:

| 指标 | H100 | B200 | 提升 |

|---|---|---|---|

| 晶体管数 | 800 亿 | 2080 亿 | 2.6x |

| 工艺 | TSMC 4N | TSMC 4NP | 定制优化 |

| Die 配置 | 单芯片 | 双芯片 | 良率更高 |

| Die-Die 带宽 | N/A | 10 TB/s | - |

为什么这么做:

- 光刻机的 reticle 尺寸有限(~850mm²)

- 强行做大芯片 = 良率暴跌 = 成本爆炸

- 两个小 die + 高速互联 = 最佳经济性

1.2 GB200 Superchip:CPU-GPU 深度融合

GB200 Superchip 是系统的核心模块,将 Grace CPU 与 Blackwell GPU 直接”缝合”:

1 | ┌─────────────────────────────────────┐ |

NVLink-C2C 关键特性:

- 带宽:900 GB/s 双向

- 对比 PCIe Gen5:7 倍带宽,25 倍能效

- 硬件一致性:CPU 和 GPU 可同时操作同一数据区域

**对称内存架构 (Symmetric Memory)**:

- GPU 可以直接访问 CPU 的 480GB LPDDR5X 内存

- CPU 可以直接访问 GPU 的 384GB HBM3e 显存

- 统一虚拟地址空间,零拷贝数据传输

实际价值:对于 RAG 或超大型 Embedding Tables,这种对称性提供了近乎本地显存的访问体验。

1.3 GB200 NVL72:机柜即计算机

NVL72 将整个机柜视为一个巨大的虚拟 GPU:

机柜配置:

| 组件 | 数量 | 功能 |

|---|---|---|

| Compute Trays | 18 | 容纳 36 CPU + 72 GPU |

| NVLink Switch Trays | 9 | 72-GPU 全互联 |

| Power Shelves | 6-8 | 5.5kW 钛金级 PSU |

| Liquid Manifolds | 1 | 冷却液分配 |

| 总重量 | 3,000 lbs | 含冷却液 (~1.36 吨) |

| 功耗 | 120-140kW | 满载 |

铜缆背板工程奇迹:

- 5000+ 根 无源铜缆

- 总长度 ~2 英里 (~3.2 公里)

- 带宽 130 TB/s

- 功耗比光纤低 ~50%

为什么用铜缆:机柜内距离短 (<10 米),1.8 TB/s 带宽下光模块功耗太高,铜缆无源设计可靠性更高。

⚡ 二、性能突破:FP4 与 Transformer Engine

2.1 第二代 Transformer Engine

Blackwell 引入了 FP4 和 FP6 精度支持,通过 Micro-Tensor Scaling 技术实现:

1 | 传统量化: |

峰值算力对比:

| 精度 | NVL72 峰值 | H100 | 提升 |

|---|---|---|---|

| FP4 Tensor Core | 1,440 PFLOPS | N/A | - |

| FP8 Tensor Core | 720 PFLOPS | 180 PFLOPS | 4x |

| FP16 Tensor Core | 360 PFLOPS | 100 PFLOPS | 3.6x |

2.2 内存层级与带宽

| 组件 | 规格 | 带宽 |

|---|---|---|

| HBM3e (GPU) | 384GB per GPU | 16 TB/s |

| LPDDR5X (CPU) | 480GB per Superchip | 512 GB/s |

| NVLink-C2C | CPU-GPU 互联 | 900 GB/s |

| NVLink 5.0 | GPU-GPU 互联 | 1.8 TB/s per GPU |

| 背板聚合 | 72 GPU | 130 TB/s |

统一内存池:

- 单 NVL72 总内存:**~30 TB** (72 × 384GB + 36 × 480GB)

- 跨 GPU 访问延迟:**

300ns** (vs 多机柜的5μs)

🌡️ 三、先进液冷与可靠性

3.1 液冷规格

| 参数 | 数值 | 说明 |

|---|---|---|

| 进水温度 | 20-25°C | W45 标准可达 50°C |

| 冷却液流量 | 80 L/min | 每机柜 |

| 系统压降 | <1.5 bar | 泵送功率优化 |

| 冷板热阻 | <0.03 °C/W | 高效传热 |

| 最高结温 | 75°C | 超限自动降频 |

冷板微通道设计:

- 微通道铜鳍片 (Skived Fin 工艺)

- 雷诺数 Re < 2000 (层流)

- 热点热通量:150 W/cm²

3.2 RAS Engine:预测性维护

Reliability, Availability, and Serviceability (RAS) Engine 是 Blackwell 的专用可靠性引擎:

| 功能 | 说明 | 价值 |

|---|---|---|

| Self-Healing | 自动定位故障源 | 减少 MTTR |

| Predictive Maintenance | 基于趋势预测故障 | 计划内维护 |

| Detailed Diagnostics | 深入诊断信息 | 节省人工排查 |

监控的遥测数据:

- 电压波动 (mV 级别)

- 温度变化 (0.1°C 精度)

- ECC 错误计数

- NVLink 误码率

🔒 四、安全特性:机密计算

Blackwell 是行业首个 TEE-I/O (Trusted Execution Environment I/O) 能力的 GPU:

1 | 传统加密: |

安全架构:

- NVLink 内联加密:GPU 间数据传输保护

- **NVIDIA Remote Attestation Service (NRAS)**:平台完整性验证

- **Reference Integrity Manifest (RIM)**:固件防篡改

适用场景:

- ✅ 医疗:病历 AI 分析

- ✅ 金融:风控模型

- ✅ 政府:敏感数据处理

🚀 五、SGLang 部署实践

5.1 单卡 GB200 运行 DeepSeek 671B

1 | python3 -m sglang.launch_server \ |

5.2 NVL72 满配部署

1 | python3 -m sglang.launch_server \ |

5.3 Kubernetes ComputeDomain 配置

1 | apiVersion: nvidia.com/v1 |

💰 六、经济性分析

6.1 自建 vs 云租赁

| 维度 | 云租赁 (H100) | 自建 (GB200) |

|---|---|---|

| 前期成本 | $0 | $3.5M+ |

| 运营成本 | $500k/月 | $20k/月 (电费) |

| 回本周期 | - | ~8 个月 |

| GPU 成本 | $2.95-16/GPU-h | $0.51/GPU-h |

6.2 TCO 对比

以运行 DeepSeek 671B 为例:

1 | 方案 A: H100 集群 |

🔮 七、未来路线图

| 平台 | 发布时间 | GPU 显存 | NVLink 带宽 | 性能提升 |

|---|---|---|---|---|

| B200 | 2025 | 192GB | 1.8 TB/s | 基准 |

| GB300 Ultra | 2025 H2 | 288GB | 1.8 TB/s | +50% 显存,+50% FP4 |

| Rubin (Vera) | 2026 | TBD | 3.6 TB/s | 2x 带宽,260 TB/s 聚合 |

📋 八、部署 CheckList

基础设施准备

1 | ### 电力 |

🎯 总结

NVIDIA GB200 平台代表了自 CUDA 平台诞生以来最重大的计算架构进步。通过重新定义 GPU 不再是独立芯片,而是72 处理器机柜级计算机的组成部分,NVIDIA 成功解决了 AI 扩展的主要瓶颈。

核心创新:

- Dual-Die 设计:突破光刻极限,2080 亿晶体管

- 对称内存:CPU-GPU 统一地址空间,900 GB/s

- FP4 精度:Micro-Tensor Scaling,2x 容量<1% 损失

- 铜缆背板:5000+ 线缆,130 TB/s,功耗最优

- 液冷系统:80 L/min,120kW 散热

- RAS Engine:AI 预测性维护

对于现代企业,GB200 NVL72 不仅仅是硬件升级,它是AI 推理时代的物理基础设施,提供了将海量数据集转化为可操作智能所需的密度、效率和安全性。

📚 参考资料

- NVIDIA Blackwell Architecture Official Page

- SGLang Documentation

- LMSYS GB200 Deployment Guide

- NVIDIA TEE-I/O Confidential Computing

标签:#NVIDIA #GB200 #Blackwell #AI 基础设施 #LLM #SGLang #深度学习